最近闲暇之余又折腾起了 OpenClaw,虽然暂时还没找到实际的使用场景,但就是手痒想捣鼓一下。

安装

我的服务器上装了宝塔面板,最简单的安装方式就是在应用商店搜索 OpenClaw 并安装。安装后会提供一个可视化后台,可以接入各类聊天通道。不过接入 QQ 似乎一直有问题,会卡在下载页面不动,不知道现在修复了没有。

目前我比较推荐接入微信,以前只能在手机端聊天,现在电脑版微信也支持了,体验好了不少。

第二种安装方式是通过 npm 或 pnpm 直接安装,这种方式没有图形界面,所有配置都在初始化时完成。如果你喜欢折腾,这条路会更有意思。

配置大脑

安装 OpenClaw 之后最关键的一步就是配置 AI 模型。OpenClaw 默认支持的供应商很丰富,比如 GPT、Gemini CLI、GitHub Copilot 等,同时也支持自定义接口,下面推荐几种方案:

GPT:配置 GPT 需要服务器不在大陆地区,或者你自己在本机部署并开启代理(小飞机)。初始化时选择 OpenAI,登录 GPT 账号授权后,就能直接使用 Codex 额度。

Gemini CLI:可以利用 Gemini CLI 的额度,但需要额外安装插件,且这种用法似乎不被 Google 认可,存在封号风险,不太推荐。

GitHub Copilot:同样是初始化时选择 Copilot 提供商。如果你开通了 GitHub Copilot,就可以使用 GPT-4o、GPT-4.1 和 GPT-5-mini 等多个模型。这些模型都不会消耗 Copilot 每月 300 次的高级请求额度,只是请求频率太高会触发限速。推荐用 GPT-4o,我之前用 GPT-5-mini 偶尔会报错,排查发现是请求格式部分不支持,但不妨碍你尝试。

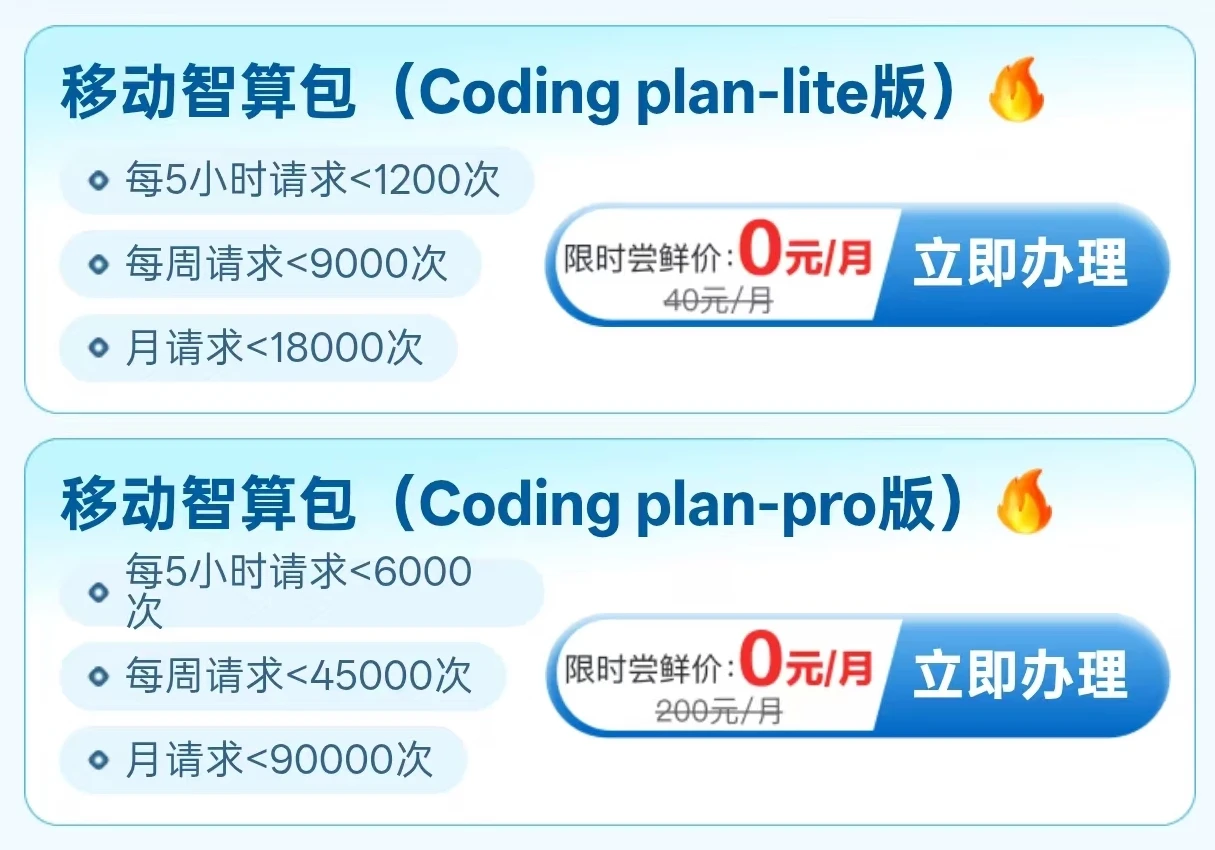

这里还要特别安利一个免费方案:中国移动的 Token 套餐。它也是按请求次数计费:普通版每 5 小时 1200 次,每周 9000 次,每月 18000 次;Pro 版每 5 小时 6000 次,每周 45000 次,每月 90000 次。缺点是目前只支持 minimax-m2.5 这一个模型,但优点就是免费!订阅后前两个月完全免费,满两个月合约自动取消,不用操心退订。

配置 OpenClaw

申请好套餐后,开始动手改配置。先打开配置文件 openclaw.json(如果找不到,记得开启系统隐藏文件显示),在里面添加一个 providers 字段:

"providers": {

"cmcc-coding-plan": {

"baseUrl": "https://zhenze-huhehaote.cmecloud.cn/api/coding/v1",

"apiKey": "这是你的key",

"api": "openai-completions",

"models": [

{

"id": "minimax-m2.5",

"name": "minimax-m2.5",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

}

}

]

}

}其中的 apiKey 在订阅后通过短信下发,cmcc-coding-plan 这个名称可以随便起。接着配置默认模型:

"agents": {

"defaults": {

"workspace": "/root/.openclaw/workspace",

"models": {

"cmcc-coding-plan/minimax-m2.5": {},

"github-copilot/gpt-4o": {},

"github-copilot/gpt-4.1": {},

"github-copilot/gpt-5-mini": {}

},

"model": {

"primary": "cmcc-coding-plan/minimax-m2.5",

"fallbacks": []

},

"compaction": {

"mode": "safeguard"

}

}

},主要是设置 primary 并将需要用到的模型都加入到 models 列表中。因为 provider 的名字我们取成了 cmcc-coding-plan,所以引用模型时一定要写成 cmcc-coding-plan/minimax-m2.5,这个名字可以按自己的喜好自由调整。保存配置并重启 OpenClaw 后,就可以愉快地白嫖了。